- 收藏

- 加入书签

多传感器融合的导盲型无人机环境感知与路径规划算法研究

摘要:针对视障人群出行面临的环境感知受限、动态避障能力不足的痛点,以及传统导盲设备与单一传感器导盲系统在复杂场景下鲁棒性差、精度不足的问题,本文开展多传感器融合的导盲型无人机环境感知与路径规划算法研究。首先构建了激光雷达、双目视觉与 IMU 组合的导盲无人机硬件系统与分层式软件架构;其次设计了基于误差状态卡尔曼滤波(ESKF)的视觉 - 激光 - IMU 紧耦合融合算法,结合 YOLOv8s 语义检测实现复杂环境下的高精度定位、建图与动态障碍物识别;随后针对导盲场景的特殊需求,优化了全局路径规划的代价函数,提出了融合动态轨迹预测与 B 样条平滑的改进 RRT * 局部路径规划算法;最后在室内外典型场景开展了对比实验。结果表明,本文算法的平均定位误差优于 0.12m ,动态障碍物检测准确率达 96.2% ,路径规划响应时间小于 15ms,动态避障成功率达 98.5% ,综合性能显著优于传统算法,可为视障人群提供安全、稳定的导盲导航服务。

关键词:多传感器融合;导盲型无人机;环境感知;路径规划;紧耦合 SLAM ;动态避障

1 引言

本文以小型四旋翼无人机为研究载体,开展多传感器融合环境感知与路径规划算法研究,重点解决复杂场景下的高精度定位建图、语义级动态障碍物精准检测、适配导盲场景的安全平滑路径规划三大核心问题,构建一套完整的导盲无人机导航系统,为视障人群提供高性能、高实用性的导盲导航解决方案。

2 多传感器融合的环境感知算法设计

环境感知是导盲无人机的核心功能,其定位精度、障碍物检测准确率直接决定了导航系统的安全性与可靠性。本文设计的多传感器融合环境感知算法分为数据预处理、紧耦合融合定位与建图、语义级障碍物检测三大核心环节,实现复杂环境下的高精度定位、语义地图构建与障碍物精准识别。

2.1 多传感器数据预处理

多传感器数据预处理的核心是实现时间同步与空间标定,为融合算法提供统一的时空基准,消除传感器安装误差与采样时间差带来的系统误差。时间同步方面,本文采用硬件触发 + 软件时间戳对齐的方案,通过机载处理器的 PPS 秒脉冲信号,触发激光雷达、双目相机与 IMU 的同步采样,实现微秒级的硬件时间同步;同时基于GPRMC 协议对各传感器的采样数据进行统一时间戳标记,完成采样数据的时间对齐,确保不同传感器数据的时间一致性。空间标定方面,首先采用张氏标定法完成双目相机的内参与畸变系数标定,消除相机镜头畸变带来的图像误差;基于 Kalibr 工具箱完成相机与 IMU 的外参标定,得到相机坐标系与 IMU 坐标系的转换关系;基于 LiDAR-IMU 标定工具箱完成激光雷达与 IMU 的外参标定,最终得到所有传感器在无人机机体坐标系下的统一转换关系,实现空间坐标的精准对齐,解决传感器安装偏差带来的坐标偏移问题。

2.2 基于 ESKF 的视觉 - 激光 - IMU 紧耦合融合算法

本文设计了基于 ESKF 的视觉 - 激光 - IMU 紧耦合融合算法,将三种传感器的原始数据纳入统一的状态估计框架,充分利用激光雷达的高精度测距优势、视觉的语义信息优势与 IMU 的高频动态响应优势,解决单一传感器在强光、弱光、弱纹理等复杂场景下的失效问题。

首先定义系统的误差状态向量,包含无人机的位置误差、速度误差、姿态误差、IMU 的陀螺仪零偏误差与加速度计零偏误差、相机 -IMU 外参误差、激光雷达 - IMU 外参误差,完整的误差状态向量为:

,

,  ,

,  ,

,  , δb_a^T, δT_ cam^T, δT_lidar^T]^T

, δb_a^T, δT_ cam^T, δT_lidar^T]^T

其中,δp 为位置误差, δV 为速度误差,δθ 为姿态误差,$\textrm { \delta b \_ g }$ 为陀螺仪零偏误差,δb_a 为加速度计零偏误差,δT_cam 为相机 - IMU 外参误差,δT_lidar 为激光雷达 - IMU 外参误差。

其次构建系统的运动预测与观测模型,基于 IMU 预积分理论构建 IMU 的运动预测模型,利用 IMU 的高频采样数据实现系统状态的200Hz 高频预测;基于双目视觉的 ORB 特征点提取与匹配,构建特征点的重投影误差观测模型,实现视觉观测的位姿约束;基于激光雷达点云的 ICP 迭代最近点匹配,构建点云的位姿匹配误差观测模型,实现激光雷达观测的位姿约束。在 ESKF 的更新阶段,将视觉重投影误差与激光点云匹配误差作为观测输入,对系统的误差状态进行最优估计,随后对系统的名义状态进行修正,得到无人机的高精度位姿估计结果。同时,算法设计了传感器失效容错机制,当某一传感器因环境干扰出现数据失效时,系统可自动切换至剩余两种传感器的融合模式,确保定位系统的连续稳定运行,大幅提升复杂场景下的环境鲁棒性。

2.3 语义级动态障碍物检测与地图构建

基于融合得到的高精度位姿,本文结合 YOLOv8s 算法实现语义级动态障碍物检测与环境地图构建,为路径规划提供带有语义信息的环境约束。首先,采用 YOLOv8s 算法对双目相机的实时图像进行目标检测与实例分割,针对导盲场景定制训练数据集,识别行人、车辆、台阶、护栏、盲道、无障碍通道、坑洼路面等 12 类典型目标,输出目标的类别、边界框、语义掩码与置信度;随后将视觉检测得到的语义信息与激光雷达的三维点云数据进行时空配准,将语义标签映射至对应的三维点云,得到带有语义信息的彩色点云,实现障碍物的三维空间定位与类别识别;最后基于卡尔曼滤波对动态障碍物的点云数据进行连续跟踪,估计障碍物的运动速度与运动方向,预测其未来 3s的运动轨迹,为动态避障提供精准的数据支撑。

基于上述感知结果,本文构建了带有语义信息的二维占据栅格地图,栅格分辨率设置为 0.1m,适配导盲场景的精度需求。栅格地图中分别标记自由空间、静态障碍物区域、动态障碍物区域、盲道区域、无障碍通道区域、禁行区域,为后续路径规划提供完整的环境语义信息与空间约束,确保规划的路径符合无障碍规范与导盲场景的安全需求。

3 面向导盲场景的路径规划算法优化

导盲场景的路径规划与传统无人机航迹规划存在本质差异,其核心目标不是实现无人机的快速飞行,而是保障视障用户的行走安全,规划的路径必须符合人行通道规范、平滑适配人体行走节奏、具备快速动态避障能力,同时保持无人机与用户的安全跟随距离。针对上述需求,本文设计了“全局路径规划 - 局部路径优化 - 动态避障”三级路径规划架构,对全局 A 算法与局部 RRT 算法进行针对性优化,实现适配导盲场景的安全、平滑、高效路径规划。

3.1 导盲场景的路径规划约束条件

本文结合视障用户的行走生理特性与《无障碍设计规范》(GB50763-2012),明确了导盲路径规划的核心约束条件:

(1)安全约束:规划路径必须避开所有障碍物,与静态障碍物的安全距离不小于 0.5m,与动态障碍物的安全距离不小于 1m ;无人机与视障用户的水平跟随距离保持在 1.5m-2m ,飞行高度保持在1.2m-1.5m ,既避免遮挡用户行走,又确保探测范围完全覆盖用户前方的行走区域。

(2)规范约束:全局路径优先选择盲道、无障碍通道等合规人行路径,禁止规划机动车道、非机动车道等非人行区域,路径有效宽度不小于 1.2m,符合国家无障碍设施设计标准。

(3)平滑约束:路径曲率连续,最大曲率不大于 0.5rad/m,无急转弯与折线路径,适配视障用户的正常行走节奏,用户行走速度适配范围为 0.5m/s-1.5m/s 。

(4)实时性约束:局部路径规划与动态避障的响应时间不大于200ms ,确保在人流密集的动态场景中能够快速响应突发风险,避免碰撞事故。

(5)人性化约束:路径优先选择人流稀疏、光照充足、无高差的区域,减少路径转弯次数,降低视障用户的行走难度与心理负担。

3.2 改进的全局路径规划算法

本文基于传统 A 算法进行全局路径规划优化,核心是改进代价函数,融入导盲场景的综合约束,使规划的全局路径在保证可达性的基础上,最大程度适配视障用户的出行需求。传统 A 算法的代价函数为:f (n) τ=τg (n) +h (n) 其中,g (n) 为起点到当前节点 n 的实际代价,h (n) 为当前节点 n 到终点的启发函数,通常采用欧氏距离计算。

本文在传统代价函数的基础上,引入导盲场景综合代价因子 cη(n) ,构建新的代价函数:f Π(n)Π=Πg (n) +h (n) + α·c (n) 其中,α 为代价因子权重系数,可根据用户需求进行调整;c (n) 为导盲场景综合代价因子,由路面平整度代价、无障碍设施覆盖代价、人流密度代价、路径转弯代价四个子项加权构成:

(1)路面平整度代价:基于栅格地图的语义信息,对非硬化路面、坑洼路面、有高差的路面设置高代价,对平整的人行硬化路面设置低代价,优先选择平整无障碍的路面;

(2)无障碍设施覆盖代价:对盲道、无障碍通道设置负代价(优先选择),对无无障碍设施的人行路径设置基础代价,对非人行区域设置无穷大代价(禁行);

(3)人流密度代价:基于动态障碍物检测结果,对人流密集区域设置高代价,优先选择人流稀疏的路径,降低视障用户与行人碰撞的风险;

(4)路径转弯代价:对路径转弯节点设置额外代价,转弯角度越大,代价越高,减少路径的转弯次数,提升路径的平顺性,降低视障用户的行走难度。

通过上述改进,全局路径规划算法可在保证路径可达性的基础上,优先选择无障碍设施完善、路面平整、人流稀疏、转弯少的最优导盲路径,完全适配视障用户的出行需求与无障碍规范要求。

3.3 改进的局部路径规划与动态避障算法

针对传统 RRT 算法收敛速度慢、路径平滑度差、动态避障能力不足的问题,本文提出了融合动态轨迹预测与 B 样条平滑的改进RRT 算法,实现局部路径的实时优化与动态避障,适配导盲场景的动态复杂环境。

算法的核心改进点包括四个方面:

(1)目标偏置采样策略:传统 RRT 算法采用完全随机采样,收敛速度慢,规划时间长。本文引入目标偏置采样策略,设置 70% 的采样概率朝向局部目标点方向, 30% 的概率随机采样,大幅提升算法的收敛速度,缩短路径规划时间,满足系统的实时性要求。

(2)动态障碍物轨迹预测与避障约束:基于环境感知模块输出的动态障碍物运动轨迹预测结果,在采样过程中对障碍物未来 3s 的运动区域设置禁行区,提前规避动态障碍物的运动轨迹,避免出现碰撞风险;同时设置动态安全距离,障碍物运动速度越快,安全距离越大,确保动态避障的安全性。

(3)路径平滑优化:传统 RRT 算法生成的路径为折线,存在大量拐点,不符合视障用户的行走需求。本文采用三次 B 样条曲线对生成的初始路径进行平滑处理,确保路径的曲率连续,满足导盲场景的平滑约束,同时通过碰撞检测确保平滑后的路径始终在自由空间内,不触碰任何障碍物。

(4)人机协同路径修正机制:结合语音交互模块,当视障用户通过语音指令调整导航目标、暂停导航或调整路径偏好时,算法可在10ms 内完成路径重规划;同时实时检测用户的行走位置,当用户偏离规划路径超过 0.5m 时,自动通过语音播报提醒,并根据用户的实时位置修正路径,确保用户始终在安全路径上行走。

4 实验测试与结果分析

为验证本文算法的有效性与优越性,搭建了导盲型无人机实验平台,在室内结构化环境与室外半结构化环境中开展对比实验,分别对

环境感知算法的定位精度、障碍物检测性能,以及路径规划算法的规划效率、平滑度、动态避障性能进行全面测试验证。

4.1 实验平台与实验环境

实验平台采用轴距 450mm 的四旋翼无人机机架,搭载 JetsonXavier NX 机载计算平台,核心传感器包括 Livox Mid-40 固态激光雷达、Intel RealSense D435i 双目相机、BMI088 高精度 IMU,机载系统采用 Ubuntu 20.04 操作系统与 ROS Noetic 机器人操作系统,核心算法基于 C++ 与 Python 实现,所有算法均在机载边缘计算平台完成实时运算,无需云端计算支持。实验设置两组对比算法:环境感知部分,与主流单一视觉 SLAM 算法 ORB-SLAM3、单一激光SLAM 算法 Cartographer 进行对比;路径规划部分,与传统 RRT 算法、传统 A 算法进行对比。

实验环境分为两类典型导盲场景:

(1)室内结构化环境:高校教学楼走廊,全长 80m ,宽度 3m,包含桌椅、墙体、台阶等静态障碍物,以及动态行走的行人,设置正常光照、弱光(关闭 80% 照明)两种光照场景;(2)室外半结构化环境:校园人行道,全长 200m ,宽度 2.5m,包含树木、护栏、台阶等静态障碍物,以及动态行驶的电动车、行走的行人,设置正常光照、强光逆光两种光照场景,完全模拟视障用户日常出行的真实环境。

4.2 环境感知算法实验结果与分析

定位精度实验结果如表 1 所示,在室内正常光照环境下,本文算法的平均定位误差为 0.08m ,显著优于 ORB-SLAM3 的 0.21m 与Cartographer 的 0.12m ;在室内弱光环境下,ORB-SLAM3 因图像特征点提取失效,平均定位误差上升至 0.47m ,Cartographer 因点云特征减少,误差上升至 0.18m ,本文算法仍保持 0.10m 的平均定位误差;在室外强光逆光环境下,ORB-SLAM3 因图像过曝出现定位丢失,Cartographer 的平均定位误差为 0.15m ,本文算法的平均定位误差仅为 0.11m ,全程无定位丢失情况。实验结果表明,本文的多传感器紧耦合融合算法充分利用了激光雷达、视觉与 IMU 的互补特性,在不同光照、不同场景下均能保持高精度的定位性能,环境鲁棒性显著优于单一传感器算法。

表 1 不同场景下各算法定位平均误差对比(单位:m)

动态障碍物检测实验结果表明,本文算法对行人、电动车等动态障碍物的检测准确率达 96.2% ,相较于单一 YOLOv8s 视觉检测的89.5% ,准确率提升了 6.7 个百分点,同时可实现障碍物三维坐标与运动速度的精准估计,速度估计误差小于 5% ,完全满足动态避障的精度需求。

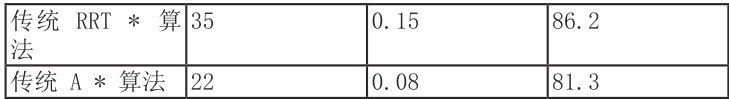

4.3 路径规划算法实验结果与分析

路径规划算法对比实验结果如表 2 所示,本文改进算法的平均路径规划时间为 12ms ,远低于传统 RRT 算法的 35ms 与传统 A 算法的 22ms ,完全满足导盲场景的实时性约束;路径曲率标准差为0.02rad/m ,仅为传统 RRT 算法的 13.3% ,路径平滑度大幅提升,完全适配视障用户的行走节奏;在动态场景下,本文算法的动态避障成功率达 98.5% ,相较于传统 RRT 算法的 86.2% 与传统 A * 算法的81.3% ,避障性能显著提升。同时,本文算法规划的路径严格遵循无障碍设施规范, 100% 覆盖盲道与无障碍通道区域,路径转弯次数较传统算法减少 40% 以上,完全适配视障用户的出行需求。

表 2 路径规划算法性能对比

综合实验结果表明,本文设计的多传感器融合环境感知算法与改进的路径规划算法,在定位精度、环境鲁棒性、规划效率、路径平滑度与动态避障性能上均显著优于传统算法,可满足导盲场景的各项性能需求,为视障用户提供安全、稳定、人性化的导盲导航服务。

5 结语

本文针对导盲场景下单一传感器系统鲁棒性不足、路径规划算法对导盲场景适配性差的核心问题,开展了多传感器融合的导盲型无人机环境感知与路径规划算法研究。构建了激光雷达、双目视觉与 IMU组合的导盲无人机软硬件系统,设计了基于 ESKF 的视觉 - 激光 -IMU 紧耦合融合算法,实现了复杂环境下的高精度定位与语义级障碍物检测;针对导盲场景的特殊需求,优化了全局路径规划的代价函数,提出了融合动态轨迹预测与 B 样条平滑的改进 RRT * 局部路径规划算法,实现了安全、平滑、高效的路径规划与动态避障。室内外多场景对比实验结果验证了本文算法的有效性与优越性。

后续研究将重点解决无人机续航能力不足、极端恶劣天气下的环境感知性能下降等问题,同时优化人机交互方案,结合大语言模型提升语音交互的智能化与自然度,进一步拓展导盲无人机的应用场景,提升系统的实用性与普适性,为视障人群的独立出行提供更完善的技术支撑。

参考文献:

[1] 廖红兵,况松陵,李扬帆,等 . 复杂场景下基于深度学习与多传感器融合的无人机配网巡检智能避障技术 [J]. 测绘通报,2025(1):22-28.

[2] 张红蕾,盛志超,叶林,等 . 基于多传感器融合的无人机自主避障方法 [J]. 激光杂志,2024,45(1):229-235.

[3] 张红蕾,盛志超,叶林,等 . 基于多传感器融合的无人机自主避障方法 [J]. 激光杂志,2024,45(1):229-235.

[4] 许晓辉,崔津华,张彬,等 . 多传感器信息融合的机械臂避障系统设计[J]. 机械工程与自动化,2024(3):32-34.

京公网安备 11011302003690号

京公网安备 11011302003690号