- 收藏

- 加入书签

自然环境下基于Faster R-CNN 模型的农业昆虫图像识别

摘要:近年来,昆虫目标检测领域见证了基于图像的自动化技术的显著进展。传统方法依赖人工识别,易受主观因素影响而导致检测精度受限。为克服此弊端,本研究采用卷积神经网络自动提取图像特征,并借助深度学习模型实现昆虫目标的精准检测。本文着重从两方面对检测模型进行优化:其一,鉴于野外采集的昆虫数据集背景复杂且图像分辨率较低,本研究将基础网络由 VGG16 升级为结构更深、参数更少的 VGG19,以增强模型对复杂背景的适应能力;其二,引入在线硬例挖掘(OHEM)策略,有效缓解了目标检测中目标帧与背景帧之间的不平衡问题。实验结果表明,改进后的 Faster-RCNN 模型准确率高达 90.12%,相较于 SSD 模型、YOLO 模型及原始 Faster-RCNN 模型,准确率分别提升了 6.52% 、 5.33% 和 3.23%, 。

关键词:Faster R-CNN;昆虫图像识别;自然环境;VGG19;OHEM

1. 引言

我国农业是国民经济的支柱,粮食安全与农业生产至关重要。然而,农业面临害虫频发问题,防控需对症下药。目前,害虫监测依赖人工,存在成本高、标准不一、效率低等弊端 [1]。近年来,基于深度学习的目标检测算法在多个领域广泛应用,展现出在昆虫目标检测中的应用潜力。引入计算机图像识别技术,有望克服人工检测局限,极大提升检测效率。图像识别包括图像采集、数据集构建、特征提取和模式识别四个步骤。早期特征提取主要聚焦全局特征,但易受背景干扰。近年来,深度学习技术推动了局部特征算子的发展,能更精确描绘目标。可通过 PCA 等工具或构建视觉词典提取特征。需注意的是,人工过程易受主观因素影响特征提取效果 [2]。

近年来,深度学习技术发展迅速,CNN 自动提取特征优势显著,成为目标检测框架核心。Faster-RCNN、Yolo、SSD 等主流框架均基于 CNN,能有效识别并分离昆虫目标。目标检测技术已广泛应用于多个领域 [4-6] 。CNN 在目标检测网络中自动提取特征并映射为特征图,模型实现识别与定位功能共享特征映射,降低对图像质量的依赖。

本文采用 Faster-RCNN 模型对自然环境中拍摄的昆虫图像进行检测和识别。由于这次使用的图像大多是在自然环境中拍摄的昆虫图像,背景复杂,会影响识别效果。因此,本文基于Faster-RCNN 目标检测,旨在训练一种能够准确检测农业昆虫图像的模型。

2. 数据集获取

2.1 图像采集

为确保模型识别的准确性,收集丰富多样的自然环境下的昆虫数字图像显得尤为重要,同时,Faster-RCNN 模型对输入图像尺寸无特定限制,能够灵活处理包含昆虫的任意大小图像。本研究通过实地拍摄与网络资源搜集两种方式,共获取了蜻蜓、螳螂、大草蛉、食蚜蝇、花蝽、棉铃虫、蚜虫、飞虱、二化螟、菜粉蝶等 10 种昆虫的图像样本 572 份。其中,458 份样本用于模型训练,剩余 114 份样本作为测试集,以验证模型的识别性能。

2.2 数据预处理

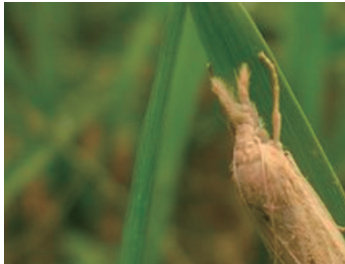

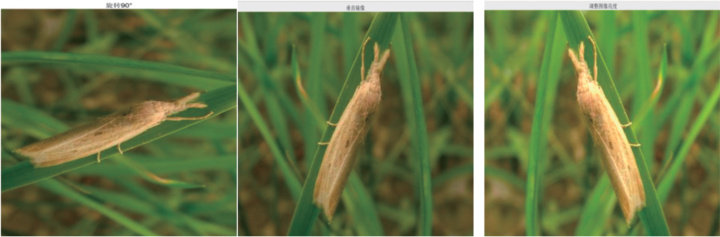

为提升模型的泛化性能,本研究采用了数据增强技术对训练集进行了有效扩展。具体而言,本研究采用了三种数据增强方法:旋转昆虫图像至不同方向和姿势;调整图像亮度、灰度和对比度;向图像中加入高斯噪声。

应用上述三种数据增强方法后,训练集图像数量得到了扩充。以二化螟为例,其样本图像在经过数据增强处理后的效果如图1 所示:

随后,采用 LableImg 工具进行人工标注处理,最终获得了与Faster R-CNN 模型接口相兼容的 voc207 格式数据集。

3.Faster-RCNN 算法原理及改进

3.1 算法原理

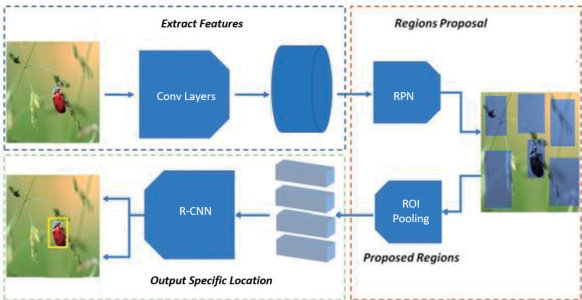

Faster-RCNN 的基本结构如图 2 所示。可以看出,Faster-RCNN由四部分组成:

(1)卷积层:主要用于提取图像的特征。输入是任意大小的图片,输出是提取的特征,输出图片称为特征图。

(2)RPN:通过RPN 网络训练从特征图中生成目标候选区域。

(3)ROI 池化:负责收集所有候选区域,计算每个候选区域的特征图,然后发送给后续网络。

(4)分类和回归层:输出候选区域的类别和候选区域在图像中的具体位置。

Faster-RCNN 基本流程:首先,输入图像至 RPN 生成候选区域,用 NMS 剔除重叠区域;其次,CNN 特征提取模块提取筛选后区域特征;最后,Softmax 分类确定目标类别,回归算法计算区域具体坐标。

3.2 算法改进

本文基于 Faster-RCNN 目标检测模型进行改进研究。针对昆虫图像普遍存在的低分辨率及复杂背景问题,本文将原模型中的基本网络VGG16 替换为 VGG19,以构建更深的卷积层结构,从而提取更为丰富的图像特征。同时,为解决目标检测中目标帧与背景帧不平衡的难题,本文引入了OHEM 方法进行处理。

对此,OHEM 的做法是设置阈值,判断候选区域是正样本还是负样本。首先保留所有正样本,然后按照正负样本 1:3 的比例对负样本进行采样,并将所有负样本的分类损失值从大到小排列,因此取分类误差高的负样本。最后,将筛选出的负样本送入 ROI 网络,并计算这些负样本的损失,然后将返回的梯度送入卷积神经网络更新整个网络。

4. 实验结果

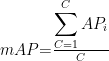

本文选取代表性指标平均精度 mAP ,基于精确率-召回率曲线(PR曲线)下的面积进行计算,其计算公式如下:

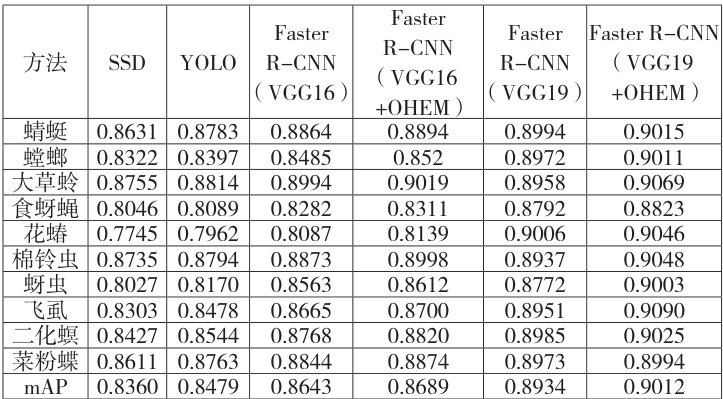

相较于 Faster-RCNN 目标检测模型,本文主要从两方面进行改进:一是以 VGG19 网络替代原有的 VGG16 作为基础网络;二是采用OHEM 方法解决目标检测中目标帧与背景帧的不均衡问题。为验证改进模型的优势,本文选取 SSD 和 YOLO 两种传统目标检测模型进行相同条件下的对比实验。所有实验均在统一环境下进行,实验结果见表1。

从表 1 可以看出,用 VGG19 替代 VGG16 后,mAP 提高了 2.91% ,从开始的 86.43% 提高到 89.34% ;利用 OHEM 解决样本不平衡,mAP从 86.43% 提高到 86.89% ,提高了 0.46% ;最后,采用 VGG19 作为基础网络和 OHEM 的 mAP 提高了 3.23% ,平均识别准确率达到90.12% 。同时,相较于传统的 SSD 和 YOLO 模型,改进后的 FasterR-CNN 模型在 mAP 上分别提高了 6.52% (相较于SSD)和 5.33% (相较于 YOLO)。实验结果表明,用 VGG19 替换 VGG16 并使用 OHEM可获得最佳识别精度。

最后,本文对模型进行了测试,测试结果如图3 所示:

5. 结论

本文采用改进的 Faster-RCNN 模型检测自然环境下农业昆虫,通过替换 VGG16 为 VGG19 和采用 OHEM 处理样本不平衡,提高了检测精度并缩短了耗时。实验结果显示,改进后模型平均准确率达90.12%。卷积神经网络的应用解决了人工特征提取问题,但数据集多样性不足和昆虫密集、部分图像识别效果欠佳是现存不足。计划在后处理阶段改进模型以解决昆虫密度问题。

参考文献

[1]Tao ZY, Sun SF, Luo CS. Study on peanut pest image recognition based on Faster-RCNN[J]. Jiang Su Agricultural Sciences, 2019, 47(12): 247-250.

[2]Luis O, Solis-Sánchez C, Eda-Miranda R, et al. Scale invariant feature approach for insect monitoring[J]. Computers and Electronics in Agriculture, 2011, 75(01): 92-99.

[3]Feng N, Hao CW, Qing LS. Image identification for twophase flow patterns based on CNN algorithms[J]. International Journal of Multiphase Flow, 2022, 152: 104-110.

[4] 葛荣泽, 武一. 基于阶段特征融合的图像融合行人检测[J/OL].电子测量技术 , 2024.

[5] 王芳彬 . 基于云平台和 CNN 的交通视频监控车辆检测方法及应用 [J]. 自动化应用 , 2023, 231(24): 227-228.

[6] 项丽萍 , 杨红菊 . 基于汇聚 CNN 和注意力增强网络的遮挡人脸检测方法 [J]. 数据采集与处理 , 2021, 36(1): 95-102.

作者简介:周强(1980—),男,汉,江西职称/ 职位:无职称,研究方向:农业工程与信息技术。

指导老师:张裔智

京公网安备 11011302003690号

京公网安备 11011302003690号